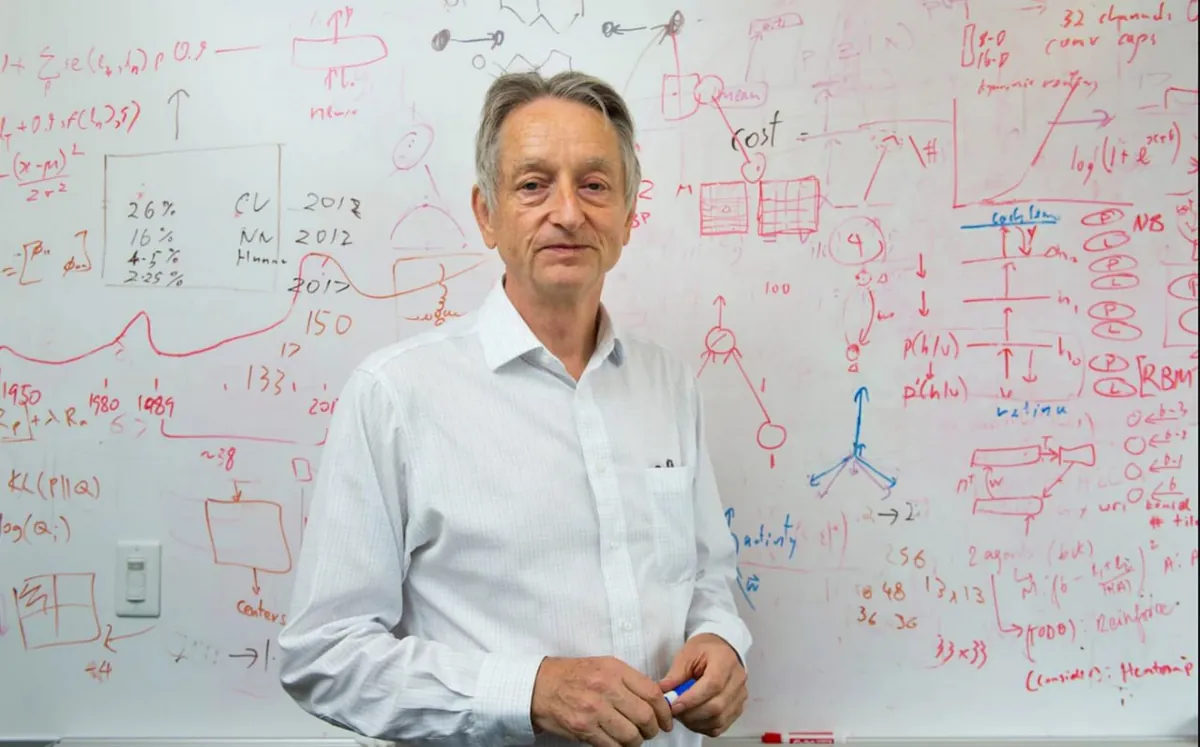

جفری هینتون، که به «پدرخوانده هوش مصنوعی» شهرت دارد، بار دیگر با هشداری جدی درباره آینده این فناوری خبرساز شده است. او که سال گذشته جایزه نوبل فیزیک را به خاطر نقشش در توسعه شبکههای عصبی دریافت کرد، معتقد است مردم هنوز از ابعاد واقعی خطرات هوش مصنوعی بیخبرند.

هینتون در مصاحبهای تازه، از سرعت سرسامآور پیشرفت این فناوری ابراز نگرانی کرده و خواستار اقدامات فوری برای کنترل آن شده است. در این مقاله، به بررسی هشدارهای هینتون، خطرات بالقوه هوش مصنوعی و راهکارهای پیشنهادی او میپردازیم.

هینتون: مردم هنوز نفهمیدهاند چه اتفاقی قرار است بیفتد!

جفری هینتون و هشدار درباره آینده هوش مصنوعی

هینتون، پیشگام حوزه یادگیری عمیق، میگوید مردم هنوز درک درستی از آنچه هوش مصنوعی برای آینده بشر به ارمغان میآورد ندارند. او که انتظار نداشت جایزه نوبل را برای کارهایش در زمینه هوش مصنوعی دریافت کند، در مصاحبهای با CBCNews گفته است: «همیشه آرزو داشتم نوبل را برای کشف نحوه کار مغز انسان بگیرم، اما هنوز این راز را حل نکردهام و به هر حال برنده شدم.»

هینتون تخمین میزند که احتمال تسلط هوش مصنوعی بر انسان بین ۱۰ تا ۲۰ درصد است، رقمی که به گفته او نباید نادیده گرفته شود. او تأکید دارد که شرکتهای فناوری باید بخش بزرگی از منابع خود را به تحقیقات ایمنی اختصاص دهند تا از فجایع احتمالی جلوگیری شود. قوانین هوش مصنوعی در ایران نیز هنوز در مراحل ابتدایی تدوین هستند و این موضوع میتواند چالشهایی برای نظارت بر توسعه امن این فناوری ایجاد کند.

خطرات هوش مصنوعی از نگاه هینتون

هینتون معتقد است هوش مصنوعی پتانسیل بالایی برای تحول مثبت در حوزههایی مثل آموزش، پزشکی و حتی مقابله با تغییرات اقلیمی دارد. با این حال، توسعه بیضابطه آن میتواند عواقب خطرناکی داشته باشد. او هشدار میدهد که اگر هوش مصنوعی از هوش انسانی پیشی بگیرد، کنترل آن برای بشر دشوار خواهد بود.

هینتون در مصاحبههایش مثال میزند که انسانها مانند کودکان نوپا در برابر سیستمهای پیشرفته هوش مصنوعی خواهند بود، با توانایی محدود برای مهار آنها. او نگران است که بدون نظارت کافی، این فناوری توسط افراد یا گروههای سودجو برای اهداف مخرب، مثل تولید اطلاعات جعلی یا سلاحهای خودمختار، استفاده شود. هوش مصنوعی علیبابا، با مدلهایی مثل Qwen که در کاربردهای تجاری و چندزبانه پیشرفت کرده، نمونهای از این توسعه سریع است که نیاز به چارچوبهای ایمنی قوی دارد.

راهکارهای پیشنهادی برای کنترل هوش مصنوعی

هینتون بارها خواستار وضع قوانین سختگیرانهتر برای شرکتهای فعال در حوزه هوش مصنوعی شده است. او پیشنهاد میکند که این شرکتها باید ۲۰ تا ۳۰ درصد از منابع محاسباتی خود را به آزمایشهایی برای کنترل هوش مصنوعی در آینده اختصاص دهند. به گفته او، همکاری بینالمللی بین دولتها و شرکتهای فناوری برای جلوگیری از سناریوهای فاجعهبار ضروری است.

هینتون معتقد است که اگرچه هوش مصنوعی هنوز از انسان باهوشتر نشده، اما این اتفاق ممکن است در ۵ تا ۲۰ سال آینده رخ دهد. او همچنین از رقابت شدید بین غولهای فناوری انتقاد کرده و میگوید این رقابت میتواند ایمنی را به حاشیه ببرد. در این میان، هوش مصنوعی اپل، که در Siri و ویژگیهای iOS با محدودیتهای بیشتری عمل میکند، نمونهای از رویکرد محتاطانهتر است، اما همچنان نیاز به بهبود دارد.

نتیجه گیری؛ هوش مصنوعی فرصت یا تهدید؟

هشدارهای هینتون نهتنها زنگ خطری برای صنعت فناوری، بلکه پیامی برای کل جامعه است. او معتقد است که بدون آگاهی عمومی و اقدامات پیشگیرانه، هوش مصنوعی میتواند به تهدیدی برای بشریت تبدیل شود. با این حال، او هنوز به پتانسیل مثبت این فناوری امیدوار است، مشروط بر اینکه با مسئولیتپذیری توسعه یابد. هینتون از دولتها میخواهد که قوانین بینالمللی برای نظارت بر هوش مصنوعی وضع کنند، مشابه آنچه در اروپا در حال شکلگیری است. این موضوع نشان میدهد که آینده هوش مصنوعی به تصمیمات امروز ما بستگی دارد.